「AIは医療をどう変えるか ~AI研究者と語る医療の未来~」前・後編医師向け

この記事は20分で読めます

講師(敬称略)

・奥村 貴史(おくむら たかし)

北見工業大学 工学部・工学研究科 教授 保健管理センター長

ピッツバーグ大学 大学院 計算機科学科

旭川医科大学 医学部 医学科 卒

インタビュアー(敬称略)

・井村 春樹(いむら はるき)

尼崎医療生協病院 内科/感染症内科

旭川医科大学 医学部 医学科 卒

京都大学大学院医学研究科

社会健康医学系専攻 健康情報学分野 専門職学位課程修了

現在、博士後期課程在籍中

・山田 康平(やまだ こうへい)

横浜市立医科大学 医学部 医学科2年

近年、AI(人工知能)の技術を利用した製品やサービスが身近なものとなり、私たちの生活に様々な変化をもたらしています。医療の分野においてもAIの導入は始まっており、診断の精度やスピードの向上などに期待が寄せられています。AIが医療の進歩に貢献する一方で、医療のあり方にはどのような変化が起きるのでしょうか。

AIを利用した診断支援研究の分野で活躍されている奥村貴史先生を招いての対談の様子を前後編でお届けします。

(mediwingより)

臨床研修を通じて感じた疑問

- 井村:

- 尼崎医療生協病院で内科をしています、井村と申します。診療支援や意思決定支援に興味がありまして、今回参加させていただきました。よろしくお願いいたします。

- 山田:

- 横浜市立大学医学部医学科2年の山田康平と申します。知識的に至らない点もあるかと思いますが、わくわくした気持ちで参加しました。よろしくお願いいたします。

- 奥村:

- 北見工業大学の奥村です。公衆衛生系の研究所にいて、公衆衛生や保健医療行政の情報化に携わっていました。そこで医療用のAI研究に出会い、10年ほど関わっています。

- 井村:

- 先生が、医療用AI研究の方針を決めるきっかけはあったのですか。

- 奥村:

- それは明確で、私が北海道の富良野で臨床研修をしていた時のことです。場所は北海道の富良野で、そこはいわゆる医療崩壊地域だったのですが、ちょうど私が研修をしていたときに、内科医が院長だけになってしまったんです。

- 井村:

- それは非常に厳しい状況ですね。

- 奥村:

- はい。見て見ぬふりをするわけにもいかず、院長と2人で内科を守りましょうということになりました。ですが、状況があまりに酷かったのです。電子カルテなど、本来仕事をサポートしてくれるはずの機械が、逆に仕事の効率を落としたり、待ち時間を増やしたりということがあまりに多く、「患者が死ぬか医師が死ぬか」というぐらいの苦境に追い込まれていました。

当時、コンピューターの基礎研究の学位を持った医師として、それはあまりにおかしいと考え、臨床研修2年間が終わった後に厚労省の研究所へ行きました。こうした経験から「本来医師や看護師、パラメディカルの仕事を支えるべきコンピューターが、何故ここまで非効率なのか。それをどうにかしたい」という思いが当初からのモチベーションの1つでしたので、それに類似する依頼が来たときに「これはチャンスだ」と思い、自分のストーリーに近いところを見つけて取り組んだという経緯になります。

医療用AIの抱える課題

- 奥村:

- 医学生の山田君は、医療用AIについてどういうイメージをお持ちですか。

- 山田:

- 医学生としては、医療用AIがいま医療従事者がしている仕事のうち何を助けていく方針になっているのか、気になっているところです。

- 奥村:

- ありがとうございます。井村先生はいかがでしょうか。

- 井村:

- 医療用AIについて初めて聞くような方、特に学生さんとか一般の医療従事者だと、AIって何かすごい魔法の道具で、場合によっては「人類を脅かしかねないのではないか」「仕事を奪われるのではないか」という懸念を抱いている方は多いと思います。僕はそうじゃない、むしろ助けてくれる技術だと思っています。基本的には補助のツールで、分かりやすい例で言うと電子カルテが挙げられます。また、奥村先生が開発を担当されている診療支援システムも医療用AIに含まれますね。

- 奥村:

- そもそも医療に限らず、社会生活一般でコンピューターと関わりがないものは、なかなか無いですよね。医療研究を助けるAIは当然のようにあり、僕らが患者さんと向き合ったときに、診断を助けるAIもあります。治療法の選択や予後の予測、次の外来あるいは何年後かに振り返る際にも関わります。言ってみれば、医療の入口から出口まで、それぞれの過程に何らかの形でAI的な技術というのが関わり得るのです。ちょっぴりイメージが湧きますか?

- 山田:

- はい。今までは、医師が診断する道筋を示してくれたり、在宅の患者さんから情報を引き出して病院につなげていく、臨床の場でのAIを強くイメージしていましたが、研究利用であったり、他の分野にも広く散らばっている印象を受けました。

- 奥村:

- そうですね。これは医師側から見た説明ですが、患者さん側にも直接関わる技術ではありますね。

- 井村:

- 患者さん自身が困っていることを自分でうまく表現できないとき、AIがどのように情報を引き出せるのか、というところは大きな課題だと思います。

例えば、患者さんが「頭が痛い」と言っているとき、本当に頭が痛いのか、痛みのステージはどうなのか、そういう情報をうまく引き出せるのかは、AIではなかなか代替、補助ができない部分ではないかと思います。こういった部分は人でもバイアスが掛かるので、それを補助するものとしてAIを使った場合に、患者さん自身の誤解がシステム自体に影響を与える可能性も課題ではないかと思います。

加えて、そもそもの課題としてAIが診断支援をするときに誰がその診断に責任を持つのか。確率的にまれな事象が起こった場合に、どう対応するのかが、今後は問われてくると思っています。

- 奥村:

- ありがとうございます。大きく2つの課題を挙げていただきました、

1つ目はAIと人間との接点、ユーザーインターフェースの問題です。相互に情報をやりとりしていく対話型のAIでないと、医師のもつバイアスに引き付けられて誤った解釈する可能性がある。それを排除するためには、人間の認知のバイアスなども含めたユーザーインターフェース研究を進める必要がありますが、なかなかそういう研究の蓄積がありません。私の行っている研究の1つがまさに、医療用AIのユーザーインターフェース研究になります。

2つ目は責任問題です。これは薬機法の問題になります。そのルール上、薬や医療機器は国が定めた品質管理基準を満たす必要があります。例えば「埋め込み型のペースメーカーで変な製品を体に入れてしまったらどうするのか」という話です。

そのため、リスクの大きなものはがちがちに縛る必要があります。しかし、実は今問題になっているのはソフトウエアの方です。 医療用ソフトウエア自体は長らく薬事的な枠組みの外にありましたが、最近になって医療用ソフトウエアも薬事の網に掛けるという動きが出てきました。しかし、技術革新と品質管理を両立させていくための方法論が確立しているとは言い難い状況にあります。

- 井村:

- そうですね。

- 奥村:

- ただ、シンプルに考えると、人の体に入れるような命に直結するものは、安かろう悪かろうでは困りますよね。けれど一方で、診断支援において「95%はこれ、5%はこれ、0.5%でこの可能性もある」と可能性を提示して、医師に判断を委ねるシステムが直ちに患者の命を奪うでしょうか。

極論ですが、診断に困った医師を支援するシステムの出力はランダムでもいい。なぜかというと、診断困難時の原因の多くは、コモンな疾患における稀な病態(atypical presentation)だからです。後から冷静になって振り返る、あるいは別の医師が関わると簡単に分かる。けれども、患者がその病院に来たときの経緯や、医師に伝えるストーリー、それまでの診療経験など、医師は色々なバイアスに囚われがちです。その結果、本来であれば辿り着ける診断に辿り着けないというケースは、おそらく多い。

そうすると、診断支援システムも「答えはコレです」というより、「この可能性を見落としていませんか」と教えてくれる方が、実は誤診などの改善にもつながる。僕らはこのことをdebiasing(デバイアシング)と呼び、医療用AIに求められる大きな機能の1つだと考えています。それは気付きを与えるものであれば何でも良くて、例えばチェックリストなど「この可能性を忘れていた」と気付かせてくれるものであれば、臨床的に有益です。

しかし、「AIの出力はこの品質を満たさなければならない」という品質管理基準を設けると、確率的に高い選択肢が上位に来ないとおかしくなる。それでは人間が持つバイアスを補強する結果になりかねない。逆に、ランダム出力を見せたほうがdebiasingに資するとしたら、そもそも品質管理基準とは何なのかということになります。

- 井村:

- なるほど。

- 奥村:

- ですから、医療用のソフトウエアの品質は、生命予後に直結するような病態の判断に関わるソフトウエアか、そうでないものかで考え方を分けるべきです。前者については、僕は法的規制派です。そうでないと技術の信用を落としてしまいます。

しかし、排除できないリスクが残るものについては、品質管理のためにレギュレーションを強めるのではなく、(自動車保険のように)何か起きた時の補償で守るべきです。そうすることで、研究者も医師も技術に対するハードルが下がり、いろいろなトライアルが可能になります。

なので、僕らはいっそのこと、間に医師が介在する相対的にリスクが少ないものは、レギュレーションの枠から外すべきだと主張しています。それが井村先生が問題提起された医療用AIの研究における責任問題に対する見解となります。

社会的な理解はこれから

- 井村:

- 先生は、他にどんな課題があるとお考えでしょうか。

- 奥村:

- 現状の課題は、大きく分けて3つあります。1つ目は先ほど話題になった、法的なレギュレーション。2つ目はデータの問題です。日本では、研究利用できるデータが諸外国と比べて明らかに不利な状況にあります。

- 井村:

- それは僕も日々実感しています。元々利用できるデータが非常に少なく、守秘義務や個人情報保護の問題もあり、オープンにされていないナショナルデータベースもかなりあります。

- 奥村:

- 3つ目は理解の問題です。それは医療従事者や医療機関トップ、あるいは各医学に関わる研究団体の執行部の理解、究極的には社会の理解の問題でもあります。AIはうまく使うべき技術ではありますが、社会的あるいは医療従事者側の理解はまだまだ相互不理解というか、意思疎通ができていないところがあります。

同じように、これから社会的な理解が進んでいく分野の例では、自動運転技術が挙げられます。AIには人間の持つバイアスがないので、おそらく死亡事故も減る。将来、自動運転がそのレベルになったときに、初めて社会的な合意が進んでいく、そういう時代が来るはずです。しかし、そこに至るまでには犠牲も出て、それに対する社会的な合意を形成しながら、少しずつ進んでいくと思います。

そこで振り返ってみて、医療用AIはどうか。僕らが現役の間はともかく、100年後、200年後と考えたときに、場合によっては医師よりもAIの方がミスの少ない分野がいくつも出てくるでしょう。人間を補う形で、技術の支援を得ようという時代は来る。そこに向けて、今の時代の研究者としてどう社会と向き合っていくのかは、考えるべき課題です。実際に僕らのところにもそういう疑問がよく寄せられています。先の話でも「医師が要らなくなるのではないか」などが挙げられましたね。

- 井村:

- そうです。「どの科がいらなくなる」あるいは「新しい診療科の形ができるのでは」という話もあります。私たちの予想では、内科系や精神科系の負担は増えるけれど、外科系や画像診断、病理などの科は、かなり自動化が進んでいくのではないかと考えています。

- 山田:

- 学部の中では、精神科に関しては「人が診ないと精神は分からない」という意見が大多数で、「AI導入後も今までと変わらない」という見方の人が多いです。一方でそれ以外の科は「自動化して負担は減っていく」と考えている人が多いと思います。

- 奥村:

- 技術進歩によって、必要なくなる治療や手技、検査はあってしかるべきで、僕らはちょうど歴史の転換期に立ち会っていると捉えた方が自然でしょう。100年後や200年後に「診断の入口自体がデジタル情報で、それに対しデジタルな反応をするタイプの診療行為は、機械の方が適している」という時代が来ても驚きはしません。ただ、恐らく僕らが現役のうちはそこまでは到達しないと思います。

- 井村:

- そうですね。いずれは洗練された外科医の技術が、オートメーション化されていく時代も来るでしょう。例えば、CTなどの画像検査においても、自分たちが見つけられていないものを教えてくれる技術は、どんどん進んでいくと思います。

それとは逆に、内科系や精神科系など、患者さんから情報を引き出す部分に関しては、もう少し時間がかかる気もします。ただ、精神科領域の診断に関しては、「対人間だとバイアスが入ってしまうが、AIだと冷静に分析できるのでは」という印象もあります。この辺りは技術の進歩とともに、自分たちが想像していないような形で変貌していくのでしょうね。

- 奥村:

- そういう意味では、懸念を持っておられる方々と、実際に研究であるとか、今の日本の医療が抱えている問題や技術が解決できるものをうまくすり合わせないと、本来は技術で突破すべきところにブレーキがかかってしまいますね。

- 井村:

- 「医療従事者の仕事が奪われる」という方向に向くと、そうなってしまいますね。本当はAIで業務がもっと楽になり、労働時間を短くするなどの目的が伝わればと思います。

- 奥村:

- 僕が言いたいのは、「医師の睡眠時間を長くする」、まさにこれです。それがある意味ゴールの1つで、このような言い方をした方が社会的な理解が進むと思います。

僕らも医師という仕事に進んだ以上、自分の人生を捧げているわけですから、夜中に起こされることそのものに不満はない。けれども、コンピューターの待ち時間や、「1ヶ月前の心電図と最新の心電図とを比較したいが、古い方は隣の病院にあり電話して取り寄せる必要があるがなかなか手元に来ない」という事態には不満が出てきます。

- 井村:

- 画像診断でCDが送られてくるけれど読み込みに時間がかかることや、電子カルテを開く時間が長いなどもありますね。

- 奥村:

- そういった点は、AIを活用し業務改善につながればと考えています。

~後編~

社会との認識のギャップを埋める

- 奥村:

- AI技術はこれから発展が見込まれる、間違いなく人類に貢献する技術です。しかし、その研究にはさまざまな制約があり、「少しずつでも成果を出していくためには、多くの方の理解を得ていかなければ」と感じています。

研究者が感じている課題と、世間あるいは一般の医師が感じている問題の間にあるギャップ。それを広く理解していただければと思います。

- 井村:

- 先生が感じておられるギャップとは、具体的にどういうところでしょうか。

- 奥村:

- 「AIが誤診したらどうするのか」という一般の懸念に対して、問題の焦点は別にあるということです。コンピューターの誤りが、すぐさま患者の健康とか生命に影響を及ぼし得るような状況では、コンピューターを使わない。あるいは、とても高い品質管理のハードルを設ける。これは当たり前でしょう。

しかし、患者に直接的な不利益やQOLへの影響がない分野の研究開発までもが、「誤診したらどうするんだ」と同じ枠組みで捉えられてしまう。すると技術開発のハードルが上がり、巡り巡って技術の可能性を狭めていると感じています。

- 山田:

- そうですね。診断の必要に迫られていて、なおかつ、患者さんの命に関わるときの誤診というのを、僕ら医学生も怖がっているというか、心配しているので、そこの誤解は大きいと思います。

- 奥村:

- 理解が進まない理由の1つは、使ってみる機会が限られていることだと思います。「現在の医療用AIはこういうもの」という情報がないまま、別の分野で発展しているAIの情報だけが大量にテレビで流れてくる。そのため、期待と実態との齟齬が生じてしまっているのだと思います。

例えば、今まさに日本中の医療機関で診断そのもの行うAI技術があります。何かイメージが湧くものはありますか。

- 山田:

- 日本中の医療機関で使われている・・・。想像したこともありません。

- 井村:

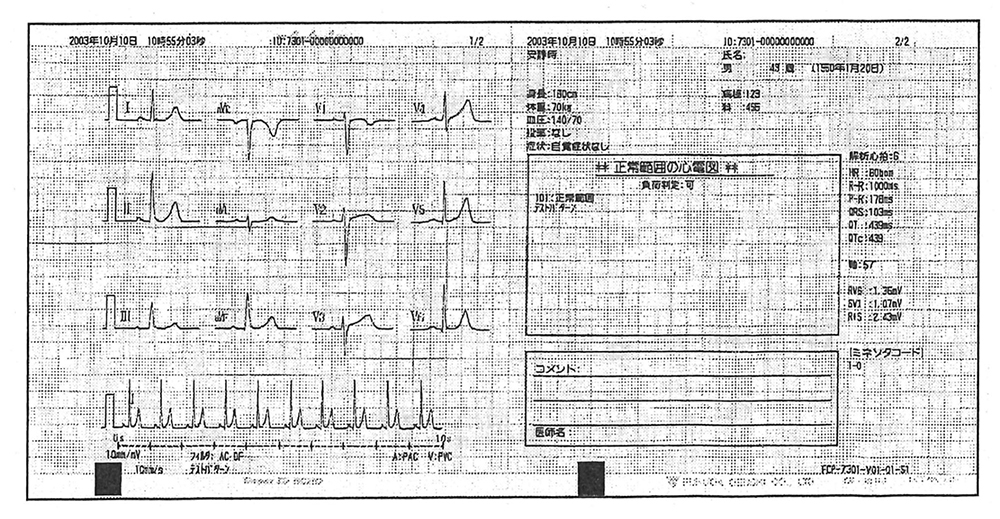

- 心電図でしょうか。

- 奥村:

- おっしゃるとおり、心電図の自動診断です。山田さんは心電図を取っているところを見たことがありますか。

- 山田:

- はい。実習は年に何回か行っていて、その中で見たことがあります。

- 奥村:

- 「異常なし」「ノーマルECG」などの診断結果が機械から出てきますね。異常心電図だと「医師の確認を要す」としながら、機械が診断した病名が表示されます。

(カーディオスター「FCP-7301 ver.03 取扱説明書」より引用)

- 井村:

- そうですね。「心筋梗塞の疑い、医師の確認を要する」などと書かれています。

- 奥村:

- その診断結果が臨床現場でどう使われるのか。僕の場合は「機械読みの結果を見るな」と指導されました。まず自分の目で診断した上で、その答え合わせのつもりで見なさいと。そうでないと、機械の診断結果というバイアスに囚われるからです。しかし、そういう習慣をつけた上で読んでみると、それなりにいいことが書かれています。

- 井村:

- 「そういえば、この可能性を見落としていた」というときがあります。

- 奥村:

- はい。それが医療の質を上げているか下げているかというと、確実に上げていると思います。

- 山田:

- 今の話で、医療用AIが誤診する・しないのではなく、人のミスを減らすための1つの指針というか、「これも参考にしたほうがいい」という情報を提示してくれるものという印象が強まりました。

- 奥村:

- そうですね。そもそも医療現場では、重大な決断を単一の情報源だけでは決めません。仮に血液検査で1つの項目が異常値だったとしても、その他の項目や全身状態、これまでの経過などを総合して判断します。

心電図の例でいうと、病棟では、各部屋、各ベッドの患者さんの心電図を遠隔でモニターへ飛ばして、様子がある程度見えるようにしています。その時、アラートに誤診があるとすると、どう思われますか。

- 山田:

- それを監督するのはあくまで医師なので、それを使っている医師の責任がかなり大きいのかなと思っています。

- 奥村:

- 法的な責任の所在はおっしゃる通りです。極端な話、僕らは、僕らの責任で相当なことをするわけですよね。けれども、その機械が誤っていた責任についてはどう思いますか。

- 井村:

- モニターが間違っていたときですね。例えば波形を見て判断して、怪しかったらもう一回心電図を取ったりするので、機械の診断のみで何かをするというのは極めて少ない。

- 奥村:

- そうですね。詰所から見えない病棟のベッドで寝ている患者さんの状況を、僕らは24時間見守れません。100パーセントでなくても、99.99パーセント信頼できる機器を使うことで、医師や看護師の手と目だけでやるよりも、チームや病棟、全体での医療安全的なパフォーマンスは明らかに上がります。

- 井村:

- 夜中に伺ったら冷たくなっていた、ということは格段に減ると思います。

- 奥村:

- そうですね。技術の本質、あるいは今実用性があるものがどういうもので、どういうことに使うべきか、使うべきでないのかという議論こそが求められています。具体的な議論の一歩前で、医療用AIが危険かどうかという話が出るとすると、研究者あるいは医療制度を持っている側の広報が、まだまだ足らないのだと思います。

- 井村:

- 実は臨床現場で浸透しているはずなのに、なぜかディープラーニングだとか世間のAI理論とごちゃ混ぜになっているんですね。僕自身も、心電図がAIだと結び付いていませんでしたが、実際に自動判定に助けられたことは何回かあります。そういう意味で、AIが自分の診療にも深く染み込んでいるなと、今改めて認識しました。

お話を伺って、医療人が「これが医療用AIだ」とまず認識するところから、理解が始まるような気がします。

- 奥村:

- 認識のギャップをどう埋めるかというのも、僕ら研究者サイドの悩みではありますね。

- 井村:

- そうですね。先生が挙げられたポイントの中で「社会の理解」、すなわち医療用AIに対して「何か怖いもの」みたいな誤解が、この技術革新を妨げている一番大きい要因のような気がします。「実はそうじゃないよ」っていうところをうまく広報していく必要があると思います。医医療用AIの発展を続ける中で、どうすれば正しい情報をキャッチできるのか、何か具体的アドバイスはありますか。

- 奥村:

- そういう意味では、僕ら研究サイドも医療従事者、とりわけ医師を対象に広報の努力を始めたところです。どの医師でも使える診断支援のツールをネットに設置し、体感してもらって、医療用AIがどういうものかを分かっていただこうとしています。

また、発展途上の技術なので、ぜひいろんな方に研究に参加してほしい。医学部を目指している高校生や、これから自分の専門を決めていく医学生、あるいは大学に戻って研究すると考えておられる医師など、さまざまな立場での参加があり得えます。ひょっとすると、この技術の研究に参加してもらうことが、一番の広報なのかなという気もしています。

- 井村:

- 「医療従事者を含む多くの人が、医療用AIの研究に携わる機会を作っていく」ということでしょうか。

- 奥村:

- はい。実際に今そのための準備をしているところです。

AIで変わる医療と、変わらないもの

- 山田:

- どの人にも、AIが導入された医療の形をイメージしきれない部分があると思います。「アルファ碁」のように自分で考え、情報を引き出してどんどん診断を進めていく医療用AI。それが誤診をしたときには、自動運転車の死亡事故のようにセンセーショナルな記事になる。そのようなイメージを持っている人も多いと思います。AIが導入された診断や、医療の形を視覚的にイメージできるようなものがありましたら、教えていただければと思います。

- 奥村:

- 技術予測はなかなか難しくて、ある技術革新が「来ない」と言って来ることもあれば、その逆もあり得ます。ただ、少なくとも僕や山田さんが現役の時代に、AIが医師を代替するような事態にはならない。それは僕ら研究者が求めているゴールではなく、今はそこまで先の話をしていないんです。

医師が健康と家族を犠牲にして、どうにか成り立っている今の医療水準を、どう現実的なコストで持続可能にするのか。それこそが、まず僕らが取り組むべき課題です。それが達成できて初めて、「診療行為のうち、この辺は機械が置き換えていく」という話が現実味を持ってきます。

ただ世界では日本より医療水準や医師数が厳しい国があって、「AIでいいから診療所を支えてほしい」という状況もあります。そういった国では導入の議論も異なるでしょうが、日本では先ほど話した通り、医師の代替ではなく支援が喫緊の課題です。

- 井村:

- 「医師の業務負担をできるだけ軽減する方向で、医師自身が仕事を長く続けられるように支援していきたい」ということですか。

- 奥村:

- それが結局のところ、日本の患者の利益になると考えています。

とりわけ地方だと、そこに医師がいないと、子どもが産めません。子どもが産めないと、人口を維持できません。それをどう解決するのかが、僕らの社会が抱えている大きな問題であって、医師を代替するかどうかというのは当面問題にならないし、なるべきではない。

例えば映画で医療用ロボットが手術をしたり、出産を助けるシーンがあります。ゆくゆくはそういう時代が来るのかもしれませんが、突き詰めると医療と同胞意識って切り離せないんですよ。結局「人間がどう生きてどう死ぬか」という話だからです。機械に「あなたの寿命は78歳です。しかし今の習慣をやめれば、○パーセントの確率で80歳まで寿命が延びます」と言われて、それが三度の飯より好きなものの場合、やめられますか。

- 山田:

- 僕なら、それで「読書やめろ」と言われたらやめないと思います。

- 奥村:

- そうです。結局価値観の問題で、自分がどう生きてどう死ぬのかという判断に対して、客観が入り込む余地はあまりないのです。なので、医師がなくなるかと言われれば、なくならない。じゃあ機械に負けるのかというと、負けたくはないですよね。

僕らは機械に負けないように学ばなければいけない。ただ、人間にもバイアスという大きな落とし穴があるので、機械と共に働くことで、どう自分たちのパフォーマンスを上げるかというのが、僕らが考えて取り組むべき課題です。

- 井村:

- そうですね。AIは医師の代わりにはならないだろうし、なるべきでもない。対立すべき存在ではなく、医師と医療用AIが共働して、人の支援に当たるというか。

- 奥村:

- より良い医療を目指すということかと思います。

- 井村:

- そうですね。医師の側だけじゃなくて患者の側も含めて、そういう未来が訪れるのを信じて、誤解が解けていければいいな、と感じました。僕自身、目からたくさん鱗が落ちました。非常に良い機会をいただきました。どうもありがとうございました。

- 奥村・山田:

- ありがとうございました。